Das Online-Kunstprojekt "ImageNet Roulette" zeigt Internetnutzern, mit wie vielen Vorurteilen Künstliche Intelligenz (KI) in Bezug auf Gesichtserkennung behaftet ist. [...]

Das Projekt „ImageNet Roulette“ wurde vom Künstler Trevor Paglen und der KI-Forscherin Kate Crawford ins Leben gerufen und soll User auf provokante Weise mit den Einschränkungen von KI konfrontieren.

Das Projekt will erforschen, „wie Menschen durch Datensets repräsentiert, interpretiert und kodifiziert werden, und wie technologische Systeme dieses Material sammeln und einordnen. Die Klassifizierung von Menschen durch KI wird immer komplexer, und dadurch zeigen sich auch ihre Vorurteile. In diesen Systemen wird aus der Einstufung schnell und heimlich ein moralisches Urteil“.

Um Gesichter zu erkennen, nutzt das Projekt die Forschungsdatenbank ImageNet, die jedem Bild ein Substantiv zuordnet. In dem Kunstprojekt zeigt sich, dass die Einschätzungen der Software über die Persönlichkeit der User in diesen Substantiven oft rassistische Klischees bedienen. Auf ImageNet Roulette ist es möglich, Fotos hochzuladen, die der ImageNet-Algorithmus dann auf Gesichter untersucht. Diese bewertet die KI schließlich nach ihrem scheinbar auffälligsten Charaktermerkmal. Diese Eigenschaften werden auf der Seite erläutert.

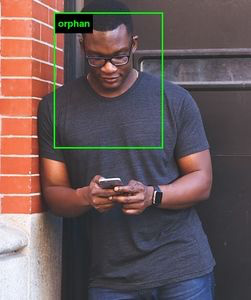

Schwarze Männer „Waisenkinder“

Im Test mit lizenzfreien Bildern schätzte die Seite farbige Männer häufig als „orphans“, also als Waisenkinder ein. Eine dunkelhäutige Frau wurde als „homegirl“ eingestuft, laut der Website handelt es sich dabei um ein weibliches Mitglied einer Gang. Einigen Twitter-Nutzern zufolge wurden dunkelhäutige Männer teilweise als „rape suspects“, also einer Vergewaltigung verdächtigt, eingestuft. Einen ersichtlichen Grund für diese Einschätzungen gibt es nicht.

Paglen und Crawford wollen mit ImageNet Roulette davor warnen, dass Gesichtserkennungssoftware oft mit problematischen Daten arbeitet. „Klassifizierungen durch KI sind für die betroffenen Personen selten sichtbar. ImageNet Roulette bietet einen Blick auf diesen Prozess und zeigt, was dabei schief gehen kann“, meint Paglen.

Be the first to comment